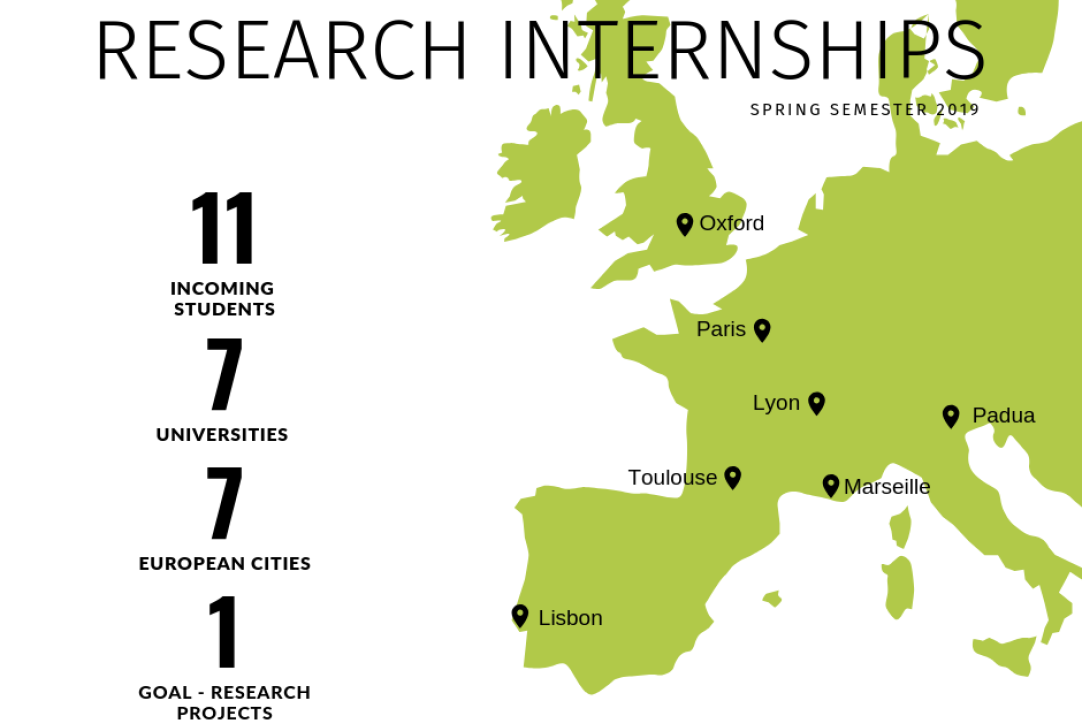

В весеннем семестре ФКН принял 11 стажеров из ведущих мировых вузов

Студенты из Франции, Великобритании, Швейцарии, Того и Албании работали над исследовательскими проектами в лабораториях ФКН в весеннем семестре 2019. Стажеры представляют следующие вузы: Оксфордский университет (Великобритания),Высшая нормальная школа Парижа (Франция), Падуанский университет (Италия), Тулузский университет (Франция), Высший технический институт Лиссабона (Португалия), Центральная высшая школа Марселя (Франция), INSA Lyon (Франция).

Один из стажеров – Диего Гранзиол, PhD студент Оксфордского университета, который провел два месяца в Центре глубинного обучения и байесовских методов ФКН. Диего рассказал нам подробнее о своем проекте в рамках стажировки:

"Во время моего пребывания я работал в Группe байесовских методов под руководством Дмитрия Ветрова. Основную часть исследований я работал совместно с Тимуром Гариповым, который является членом группы. Мы начали с внедрения кодовой базы Тимура в мой предыдущий проект (спектральный стохастический градиентный спуск) и подведения некоторых теоретических результатов в его предыдущую работу “stochastic weight averaged gaussians”.

Что интересно, мы заметили, что, в то время как кривизна, полученная в начале обучения, была очень близка к подобранной вручную, связанное с этим снижение скорости градиентного спуска может «взорвать» спектр, что в свою очередь замедлит скорость спуска ещё больше и тем самым полностью остановит его. Это было небольшое разочарование. Более того, для выпуклой квадратичной задачи можно доказать, что метод главных компонент, использующийся в SWAG, не даст того же базиса из собственных векторов, что и для основной выпуклой задачи.

Следующей нашей целью было понять общий принцип: мы посмотрели работу Ледуа и Вольфа для ковариационных матриц больших размерностей из многомерной статистики и реализовали метод сжатия коэффициента для глубоких нейронных сетей для обучения коэффициента L2 регуляризации. Мы поняли, что коэффициент регуляризации, полученный из спектра с использованием нашей реализации, достаточно хорошо соответствует коэффициенту выбранному вручную перебором по решетке, и что он увеличился во время обучения, в течение которого доверие к эмпирическому гессиану уменьшится из-за переобучения. Результаты выглядели многообещающе вплоть до конца, когда скорость обучения снижалась, а ширина и дисперсия спектра увеличивались до уровня, при котором доверие к эмпирическому гессиану становилось равным 0, что останавливало обучение и давало плохую производительность. Однако мы это исправили, выбрав графики скорости обучения, в которых скорость не снижается так быстро.

Последняя часть работы, которая была представлена NeurIPS и workshop ICML, «Теоретическая физика в области глубинного обучения» (она была принята и представлена на прошлой неделе) была сосредоточена на понимании обобщения с точки зрения отклонений от истинной поверхности риска до поверхности эмпирического риска. Это была особенно тяжелая неделя, так как у моего партнера по исследованиям были экзамены и постоянные встречи по поводу получения визы, поэтому большая часть работы (написание статей, разработка идей и всей математической части, которая основывалась на низкоранговых возмущениях группы Вигнера) легла на мои плечи. Были проведены обширные эксперименты с использованием аугментации данных о спектрах, пакетных спектрах и методах Ньютона по логистической регрессии в качестве "игрушечного" примера.

Я не могу не подчеркнуть, насколько мне повезло и какой честью для меня было приехать в Россию, работать со всей Группой байесовских методов. Атмосфера была теплой и гостеприимной. Тимур – по-настоящему изумительный кодер, и без него я бы не сдвинулся с мертвой точки ни по одной из моих собственных идей. Я думаю, у него есть потенциал заниматься поистине совершенно исключительными исследованиями, и я невероятно рад следить за его успехами. Я благодарю Дмитрия, чей финальный вклад в документ, который мы отправили в NeurIPS, был совершенно необходим, за наши регулярные встречи, советы, вопросы, поддержку и время.

Я надеюсь, что у меня появится возможность вернуться и поработать снова с Исследовательской группой байесовских методов".

Узнай больше о возможностях стажировок на факультете компьютерных наук.

Ветров Дмитрий Петрович

Центр глубинного обучения и байесовских методов: Заведующий центром